robots.txt ファイルは、Web サイトのサーバー上にあるシンプルなテキスト ファイルで、Web クローラーまたはボットにサイトのページをナビゲートしてクロールする方法を指示します。

これは Robots Exclusion Protocol (REP) の一部であり、主にクローラー トラフィックを管理し、サイトの特定のページまたはセクションが検索エンジンによってインデックス化されるのを防ぐ役割を果たします。

ここで扱われる内容:

robots.txtの重要性

- ウェブクローラーの制御: Web クローラーに、どのページにアクセスできるか、アクセスできないかを通知し、検索エンジンがサイトをどのように認識するかを管理するのに役立ちます。

- 機密情報を保護する: 個人情報や機密情報を含むページへのクローラーのアクセスをブロックできます。

- クロールバジェットの最適化: 重要でないページをブロックすることで、検索エンジンがサイトの最も重要な部分に集中するようになります。

- サイトパフォーマンスの向上: クロールするページ数を減らすと、サーバーの負荷が軽減され、サイト全体のパフォーマンスが向上します。

- 重複コンテンツを防ぐ: 検索エンジンが重複コンテンツをインデックスするのを防ぎ、サイトの検索ランキングを向上させることができます。

- サイトのセキュリティを維持する: サイトの管理領域やセキュリティ保護領域へのアクセスをブロックするために使用できます。

- ユーザー エクスペリエンスの向上: クローラーのアクセスを管理することで、ユーザーがサイトを検索したときに最も関連性の高い重要なコンテンツが確実に見つかるようになります。

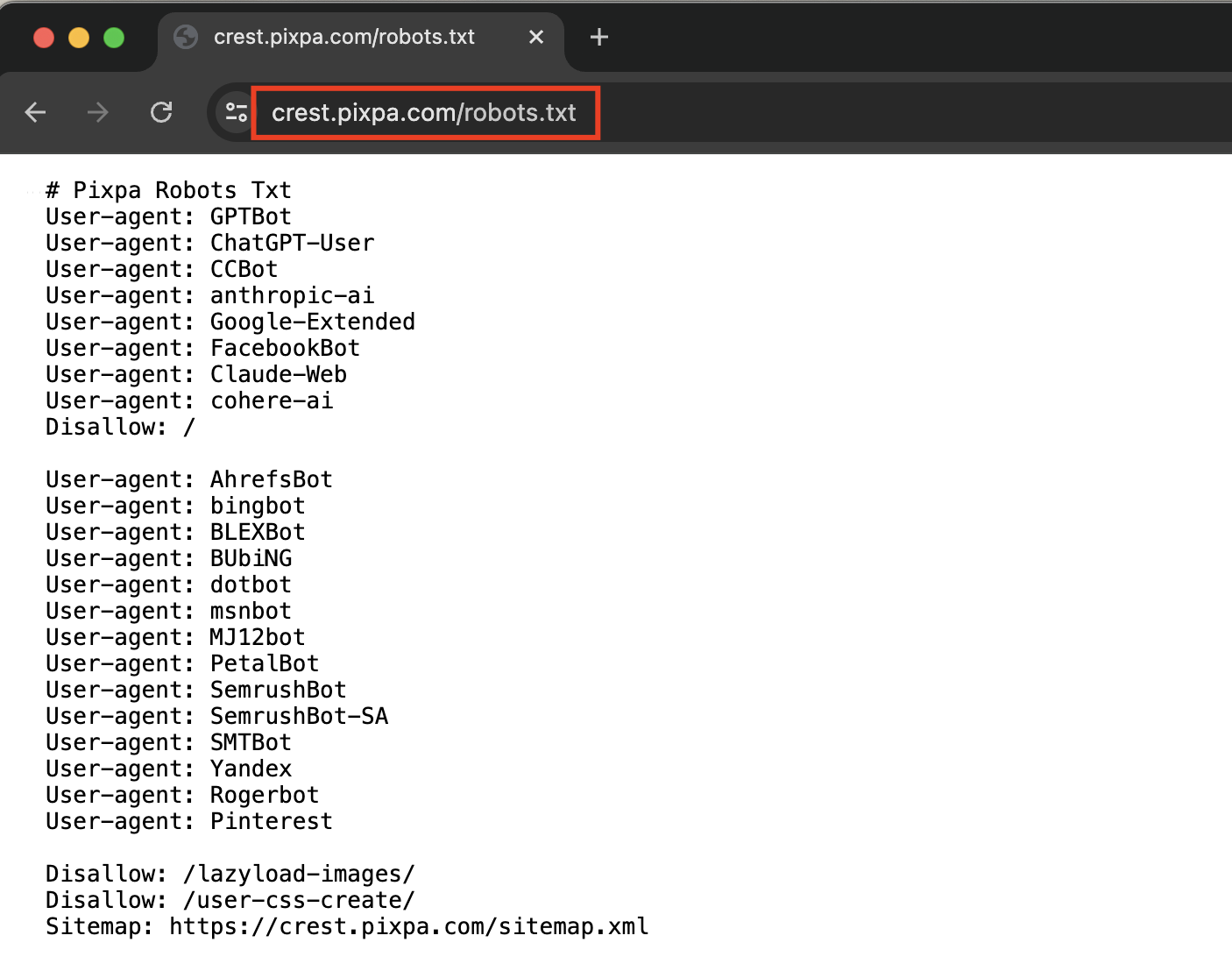

ウェブサイトのrobots.txtを確認してください

ウェブサイトの robots.txt ファイルを開くには、以下の手順に従ってください。

- Web ブラウザ (Chrome、Firefox、Safari など) を開きます。

- アドレスバーにウェブサイトのURLを入力し、その後に「/ロボット.txt' (引用符なし)。

- たとえば、ウェブサイトのURLがwww.example.comの場合、次のように入力する必要があります。 ロボット ファイルを開きます。

robots.txt 内のディレクティブ

- ユーザーエージェント: ルールが適用されるウェブクローラーを指定します。アスタリスク(

*) は、ルールがすべてのクローラーに適用されることを意味します。 - 禁じます: クローラーに特定の URL パスにアクセスしないように指示します。

- 許可する: 上書きする

Disallow特定の URL パスへのアクセスを許可するディレクティブ。 - サイトマップ: サイトマップ ファイルの場所を指定します。これは、検索エンジンがサイトの構造を理解するのに役立ちます。